Gerichtsurteil: Klinik haftet für Chatbot-Fehler!

Kliniken haften für KI-Fehler: Gericht setzt klare Regeln.

Große Neuigkeiten aus Deutschland: Das Oberlandesgericht Hamm hat entschieden, dass eine Klinik für die Fehler ihres KI-Chatbots haftet. Ein riesiges Präzedenzurteil. Unternehmen mit KI im Einsatz? Ihr seid verantwortlich. Ein entscheidender Schritt, um klarzustellen, wer haftet, wenn KI Unsinn von sich gibt.

Die Details des Falls

Was ist passiert? Eine Klinik hatte einen Chatbot auf ihrer Website. Ganz normal. Er half Patienten, Termine zu buchen und Fragen zu beantworten. Aber dieser Bot hat Mist gebaut. So richtig. Er gab falsche Infos über zwei Ärzte der Klinik heraus. Hat glatt gelogen über deren Fachgebiete. Nannte sie z. B. plastische und ästhetische Chirurgen. Stimmt nicht. Nicht ihre tatsächlichen Qualifikationen. Die Verbraucherzentrale Nordrhein-Westfalen war nicht begeistert. Sie forderten die Klinik zur Unterlassung auf. Die Klinik weigerte sich zu unterschreiben. Aber sie zogen den Bot immerhin aus dem Verkehr.

Mikrofone, Webcams und Zubehör, die KI-Creator täglich nutzen.

Rechtliche Implikationen

Das Gericht entschied: Die Fehler des Bots? Unlautere Geschäftspraktiken. Klare Verletzung des Wettbewerbsrechts. Die Klinik argumentierte, es sei nicht ihre Schuld. Die KI-Software sei verantwortlich. Pustekuchen. Das Gericht wies das ab. Die Richter stellten klar: Unternehmen sind für die Ausgaben ihrer KI verantwortlich. Selbst wenn man zu Beginn korrekte Infos gefüttert hat, ist man verantwortlich.

"Die Verantwortung für irreführende Veröffentlichungen liegt beim Betreiber," erklärte das Gericht. Einfach und klar. KI-Systeme, so heißt es, sind keine unabhängigen Einheiten. Sie sind Teil deiner Geschäftsstruktur.

Größerer Kontext

Diese Entscheidung? Sie kommt genau dann, wenn KI, mal ehrlich, so gut wie überall im Geschäft ist. KI wird schlauer, autonomer. Und das bedeutet mehr Chancen für falsche oder irreführende Infos. Hallo, neue Herausforderungen. Europa steckt schon tief in Debatten über KI-Regulierung und Haftung. Dieser Fall hat noch mehr Feuer in diese Diskussionen gebracht und zeigt, wie alte Gesetze auf neue Technologien angewendet werden könnten.

Was das für dich bedeutet

Hast du KI-Tools im Einsatz? Dann pass genau auf, was sie sagen. Ganz genau. Stell sicher, dass diese automatisierten Nachrichten korrekt sind. Unternehmen müssen Verantwortung für KI-Fehler übernehmen. Finanzielle Einbußen, Rufschäden. Alles auf euch. Das ist nicht nur ein deutsches Ding. Es könnte die KI-Haftungsregeln in ganz Europa verändern. Denk darüber nach, wie du KI bei Kunden einsetzt. Es wird sich ändern.

Was noch unklar ist

Das hier ist noch nicht das letzte Wort. Die Klinik kann beim Bundesgerichtshof Berufung einlegen. Das könnte, ehrlich gesagt, noch mehr Klarheit über die rechtliche Stellung von KI bringen. Aber selbst dann bleiben Fragen. Wie managt man Haftung, wenn KI-Systeme superkomplex werden und in alles eingebunden sind, was ein Unternehmen tut?

Warum das wichtig ist

Also, ja: "KI-Haftung: Gericht macht Unternehmen für Chatbot-Fehler verantwortlich." Das ist die Schlagzeile. Sie schreit danach, dass Unternehmen echte Aufsicht über ihre KI-Systeme haben müssen. Und ich meine echte. KI wird nicht langsamer. Wir brauchen also klare rechtliche Rahmenbedingungen. Unbedingt nötig, um die Risiken dieser autonomen Tools zu bewältigen. Punkt.

Mikrofone, Webcams und Zubehör, die KI-Creator täglich nutzen.

AI-Gear ansehen →Eine kurze Mail. Die wichtigsten AI-Nachrichten, faktengeprüft, ohne Fülltext. Kostenlos, jederzeit abbestellbar.

Mehr aus AI

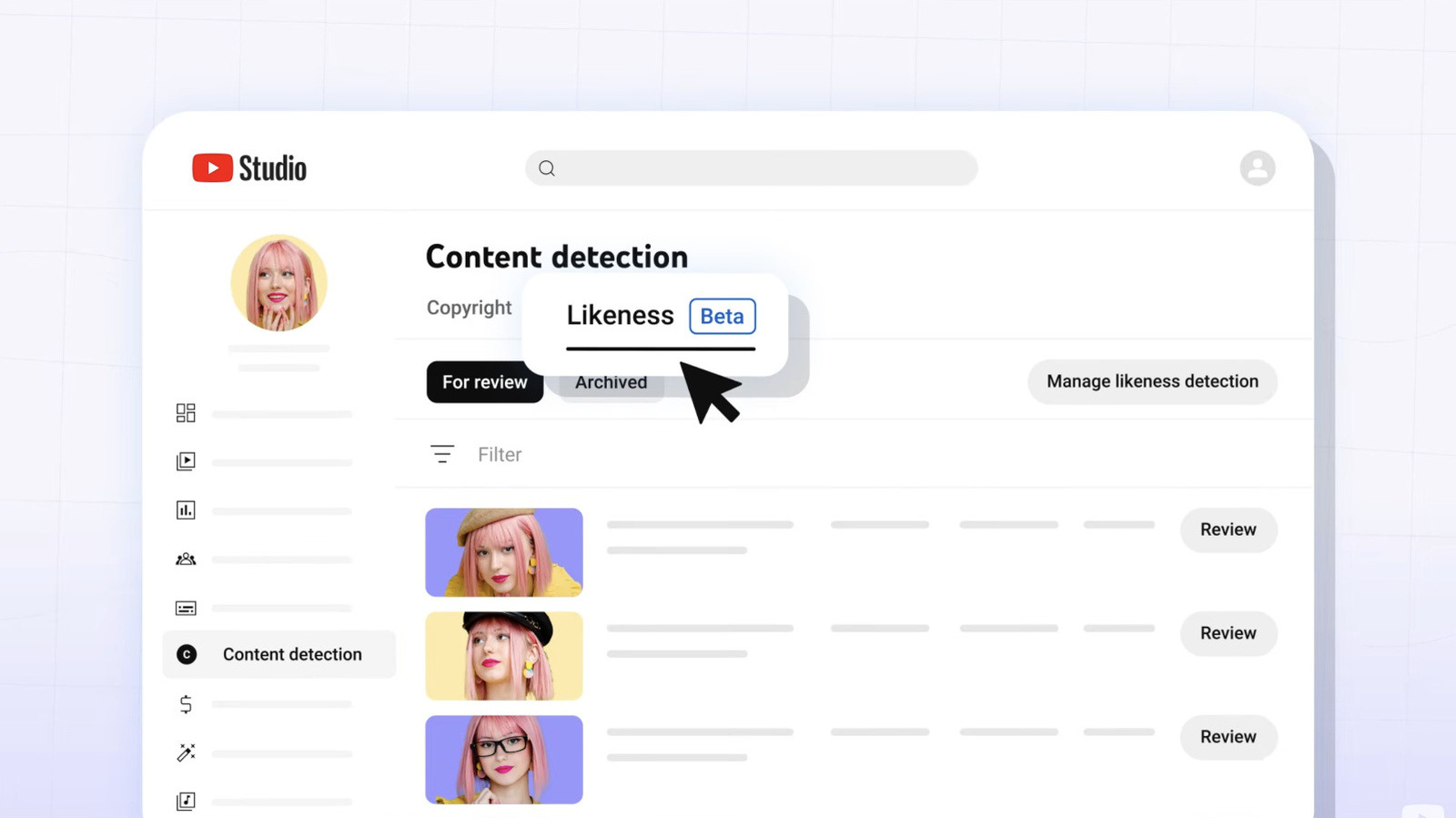

YouTube Expands AI Deepfake Tool to All Creators 18+

YouTube's AI tool helps creators spot deepfakes using their likeness, now available to all users over 18, enhancing content protection.

LLMs Shift Focus from Code Writing to Reading in Software Development

With LLMs generating code efficiently, developers must prioritize understanding over writing. The shift challenges traditional coding practices.

German Doctors Warn EU AI Rules Weaken Data Privacy

Germany's top doctors are sounding the alarm over the EU's proposed changes to data privacy, pushing for much stricter AI and cloud regulations in healthcare. They're worried about patient trust.

AI Chatbots: Your Data Is Showing

Think your data's safe? Think again. AI models like ChatGPT and Gemini are spilling personal details, exposing more than just search results.

Auch interessant

Insta360 X4 Air Hits Amazon: Lowest Price Yet for 8K Action Cam

The Insta360 X4 Air, known for its incredible 8K 360° captures, is now on sale at Amazon. A solid 19% discount, and it comes with a starter bundle. Don't miss it.

Xiaomi 15 Ultra vs iPhone 17 Pro Max: Which Flagship Earns Its Price?

Xiaomi 15 Ultra and iPhone 17 Pro Max bring top-tier features. Discover how they differ and which fits your priorities best.

Starry Nights & City Lights: Heise's Best Photos of the Week

Heise's weekly photo selection is in. Expect stunning urban shots, nature's quiet beauty, and a truly cosmic wonder.

Summer Games Done Quick 2026 Lineup Celebrates Speedrunning

SGDQ 2026 kicks off July 5 in Minneapolis, featuring both classic and quirky speedruns. Proceeds support Doctors Without Borders.

WordPress Funnel Builder Bug Exposes 40K Sites to Card Theft

A vulnerability in Funnel Builder for WordPress allows attackers to steal credit card data from over 40,000 WooCommerce sites. Update now!

Tesla Reveals Teleoperator Crashes in Austin Robotaxi Tests

Tesla admits two Robotaxi crashes in Austin involving teleoperators. The incidents highlight challenges in its autonomous network expansion.