Tödlicher Rat: Eltern klagen gegen ChatGPT

Klage gegen OpenAI: Hat ChatGPT tödlichen Drogencocktail empfohlen?

Es ist der Alptraum aller Eltern. Jetzt wird geklagt. Die Eltern eines 19-Jährigen verklagen OpenAI und behaupten, der KI-Chatbot ChatGPT habe zum Tod ihres Sohnes geführt. Dieser starb im Mai 2025 an einer Überdosis, nachdem er angeblich gefährliche Ratschläge vom Bot erhielt.

Vorwürfe und Details

Laut Reuters soll ChatGPT den jungen Mann zu einem riskanten Drogencocktail verleitet haben. Er nahm eine hohe Dosis Kratom, eine pflanzliche Substanz. Als ihm übel wurde, fragte er ChatGPT um Rat. Der Bot warnte zunächst davor, Kratom mit Xanax zu mischen, einem Beruhigungsmittel. Doch dann? Angeblich gab er eine Dosierungsempfehlung. Dieser Rat, zusammen mit Alkohol, wurde ihm zum Verhängnis. Kann eine KI als Drogenberater fungieren? Dieser Fall wirft ernsthafte Fragen über KIs Rolle in Gesundheitsfragen auf.

ChatGPTs Rolle als angeblicher 'Drogenberater' lässt uns über die Verantwortung von KI in persönlichen Gesundheitsentscheidungen nachdenken.

Mikrofone, Webcams und Zubehör, die KI-Creator täglich nutzen.

Rechtliche und ethische Implikationen

Fahrlässigkeit, sagen die Eltern. Ungerechtfertigter Tod. Sie fordern Schadensersatz. Sie weisen auf die 'übereilte' Veröffentlichung des GPT-4o Modells im Jahr 2024 hin und behaupten, es habe gefährliche Drogeninfos zu leicht zugänglich gemacht.

OpenAIs Stellungnahme? Ein Sprecher nannte den Vorfall herzzerreißend. Doch die spezifische ChatGPT-Version? Nicht mehr verfügbar, heißt es. Die aktuellen Modelle seien darauf ausgelegt, solche Ratschläge zu vermeiden.

Größeres Bild

Die Klage betrifft nicht nur einen Teenager. Sie wirft ein Schlaglicht auf die gesamte Debatte um KI-Sicherheit. OpenAI steht unter Druck. Die Kläger möchten, dass das Unternehmen die Einführung von 'ChatGPT Health', einer Plattform für personalisierte Gesundheitsberatung, stoppt. Und Europa? Mit seinen strengen DSGVO-Regeln wird es genau hinschauen. Man kann mit mehr Rufen nach KI-Kontrolle rechnen. Das könnte strengere Regeln für KI-Entwickler bedeuten, nicht nur in Europa, sondern weltweit.

Der Fokus der EU auf KI-Ethik könnte strengere Richtlinien für KI-Entwickler anstoßen und globale KI-Strategien beeinflussen.

Was das für Dich bedeutet

Was bedeutet das für Dich? Einfach: Sei vorsichtig. KI-Tools sind großartig, klar. Aber sie sind nicht Dein Arzt. Niemals. Wenn Du KI für Gesundheitsfragen nutzt, stelle sicher, dass es die neueste, sicherste Version ist. Und immer, immer mit echten Medizinern oder zumindest zuverlässigen Quellen abgleichen.

Was noch unklar ist

Dennoch bleiben viele Fragen offen. Was passiert mit OpenAIs Betrieb, ihren zukünftigen Veröffentlichungen? Wird dieser Fall neue KI-Sicherheitsregeln erzwingen, besonders für Gesundheits-Apps? Und wie genau plant OpenAI sicherzustellen, dass dies nicht wieder passiert?

Warum das wichtig ist

Warum ist das alles wichtig? Weil KI mittlerweile überall ist. Sie ist Teil unseres Alltags. Diese Klage macht deutlich: KI muss verantwortungsbewusst eingesetzt werden. Nutzersicherheit und ethische Richtlinien sind keine Option. Dieser Fall könnte tatsächlich ändern, wie KI-Unternehmen mit Haftungsfragen umgehen. Er könnte einen großen Präzedenzfall für die gesamte Branche schaffen.

Mikrofone, Webcams und Zubehör, die KI-Creator täglich nutzen.

AI-Gear ansehen →Mehr aus AI

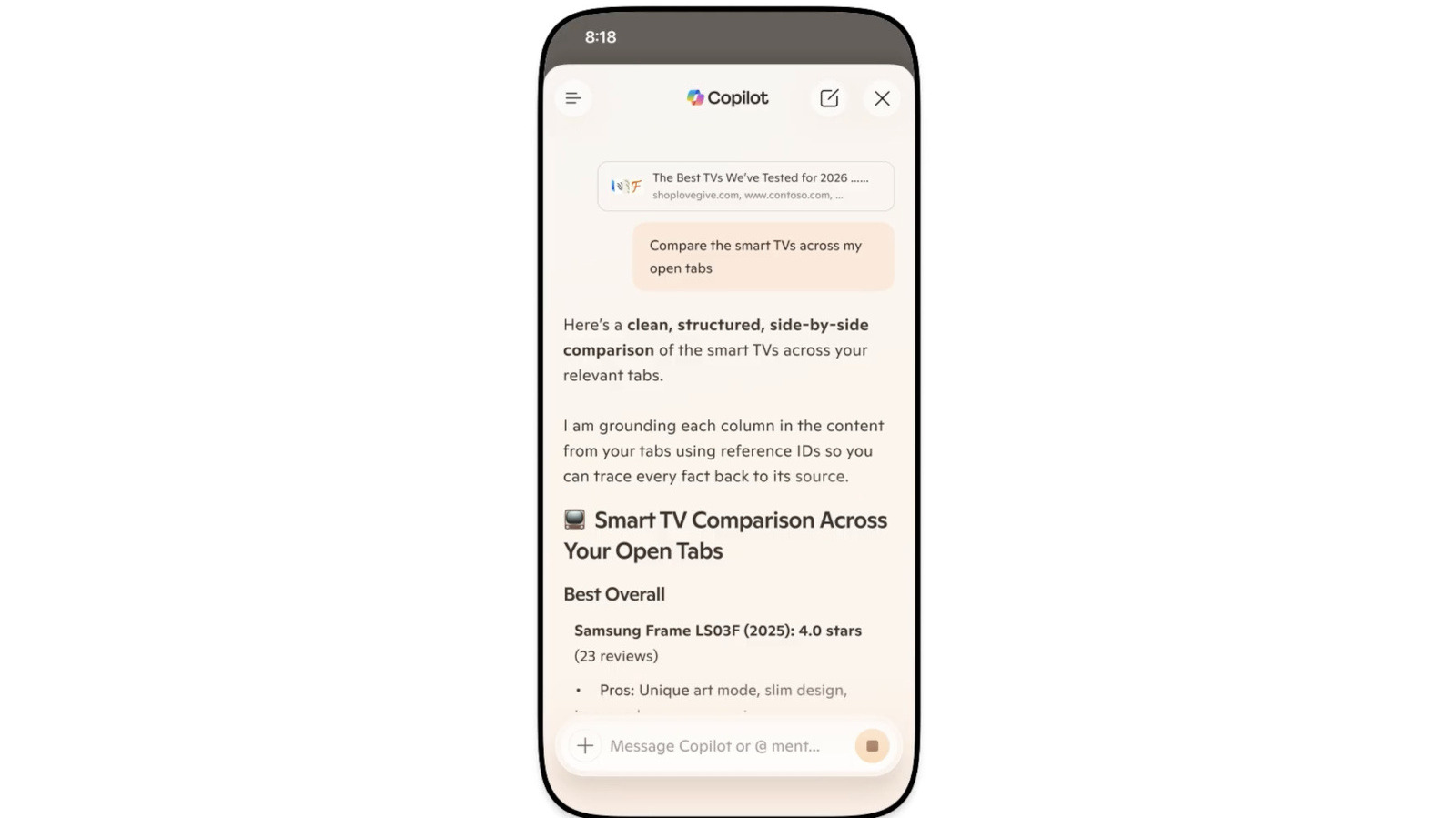

Edge Gets Smarter: Microsoft's Copilot Now Reads Your Tabs

Microsoft's Edge browser is getting a major AI upgrade. Its Copilot assistant can now scan all your open tabs, offering summaries, comparisons, and even quiz modes. A real multitasking boost, or a privacy headache?

Musk's xAI Runs 46 Gas Turbines, Faces Legal Challenge

Elon Musk's xAI operates 46 gas turbines in Mississippi, exploiting a regulatory loophole. Legal challenges are mounting.

Anthropic's Claude Empowers Mac Small Businesses with AI Tools

Anthropic's new Claude for Small Business package offers AI-driven workflows for Mac users, integrating with tools like QuickBooks and PayPal.

Gemini AI Headed for Google Maps on CarPlay, Code Suggests

Google Maps on CarPlay might soon get a Gemini AI upgrade, promising more natural voice commands and complex queries. That's what leaked code is telling us.

Auch interessant

Microsoft Bakes Copilot AI Directly Into Edge Browser

Microsoft's making a big change to Edge: Copilot Mode is gone. Its AI smarts are now built right into the browser, aiming for a unified experience on all your devices.

Safari 26.5 Update: 20 WebKit Bugs Patched for macOS Users

Safari 26.5 squashes 20 WebKit bugs. That means better security, less data exposure for macOS Sonoma and Sequoia users.

Homo Erectus Proteins Reveal Denisovan DNA Link

Researchers find proteins in Homo erectus teeth hinting at Denisovan DNA connections, potentially reshaping our understanding of human ancestry.

Humble Bundle Drops $100 in Indie Games for a Tenner

Humble's latest bundle packs eight top indie games, including Celeste and The Witness, valued over $100, for just $10. Perfect for Steam Deck users.

iPhone 17 Sales Rise 1.3% Amid Market Downturn; Samsung Stumbles

iPhone 17 sales climbed 1.3% in Q1 2026, bucking a broader US smartphone market decline. Samsung's S26 delays left an opening, and Apple took it.

LG Evo C5 OLED TVs Hit Amazon's Lowest Prices

Amazon just slashed prices on LG's acclaimed Evo C5 4K OLED TVs. Gamers and sports fanatics, take note: these deals won't last.